Début du contenu principal.

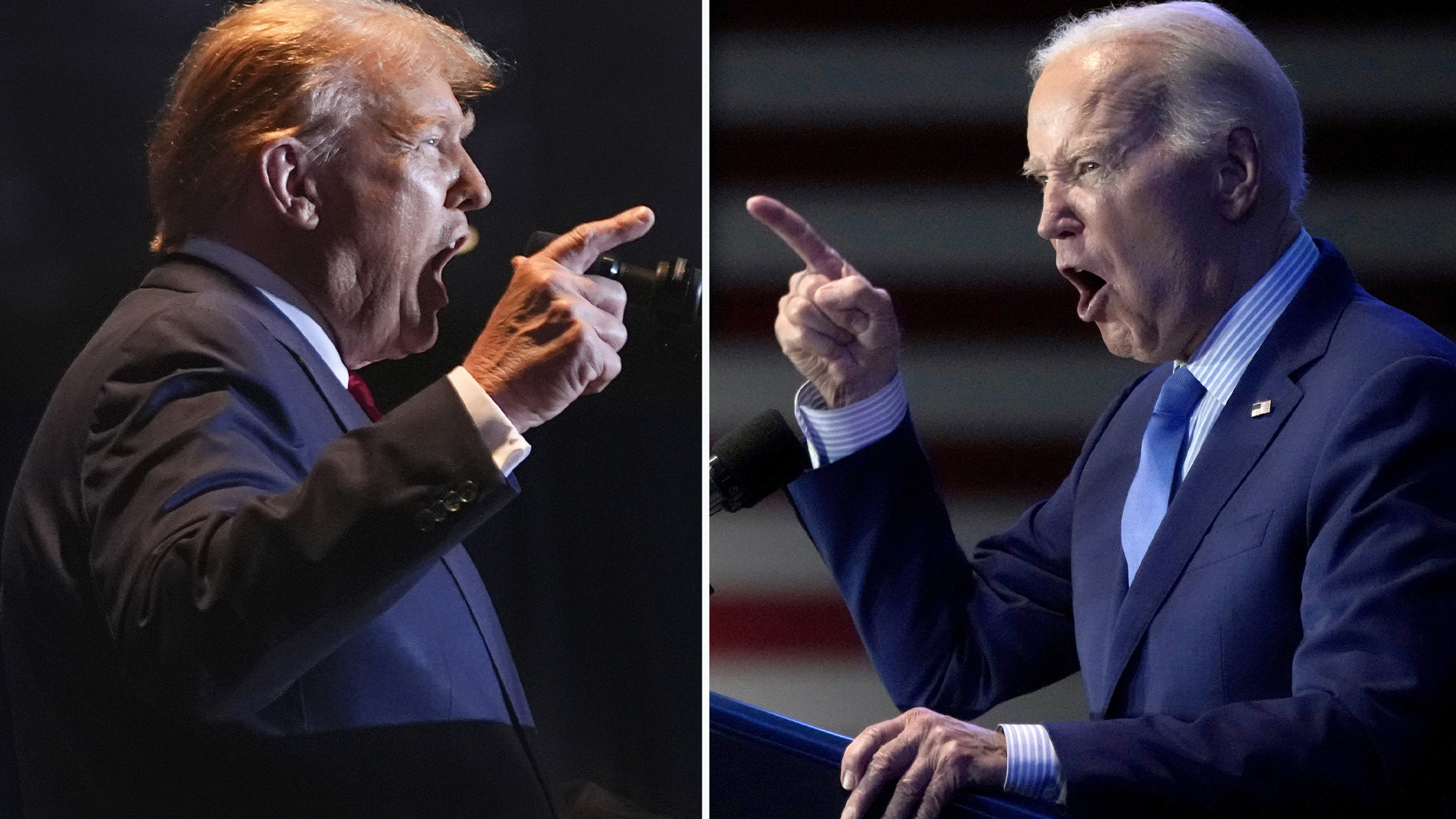

IA: de fausses images de Trump préoccupent

À première vue, les images circulant en ligne et montrant l'ancien président américain Donald Trump entouré de groupes d'Afro-Américains souriants et rieurs ne semblent pas sortir de l'ordinaire, mais en y regardant de plus près, on s'aperçoit qu'elles ont été créées à l'aide d'une intelligence artificielle.

Un éclairage étrange et des détails trop parfaits indiquent qu'elles ont été générées à l'aide d'une intelligence artificielle. Ces photos, qui n'ont pas été associées à la campagne de M. Trump, sont apparues alors que ce dernier cherche à séduire les électeurs noirs qui, selon les sondages, restent fidèles au président américain Joe Biden.

Les images fabriquées, mises en évidence dans une enquête récente de la BBC, apportent des preuves supplémentaires à l'appui des avertissements selon lesquels l'utilisation d'images générées par l'intelligence artificielle ne fera qu'augmenter à l'approche des élections générales de novembre. Selon les experts, ces images mettent en évidence le risque que n'importe quel groupe - les Latinos, les femmes, les électeurs masculins plus âgés - soit ciblé par des images réalistes destinées à induire en erreur et à semer la confusion, et démontrent la nécessité de réglementer cette technologie.

Dans un rapport publié cette semaine, des chercheurs du Center for Countering Digital Hate, organisme à but non lucratif, ont utilisé plusieurs programmes d'IA populaires pour montrer à quel point il est facile de créer des «deepfakes» réalistes susceptibles de tromper les électeurs. Les chercheurs ont pu générer des images de Trump rencontrant des agents russes, de Biden bourrant une urne et de miliciens armés dans des bureaux de vote, même si nombre de ces programmes d'IA affirment avoir des règles interdisant ce type de contenu.

Le centre a analysé certains des «deepfakes» récents de Trump et d'électeurs noirs et a déterminé qu'au moins l'un d'entre eux avait été créé à l'origine comme une satire, mais qu'il était maintenant partagé par les partisans de Trump comme une preuve de son soutien parmi les Noirs.

Les plateformes de médias sociaux et les entreprises spécialisées dans l'IA doivent faire davantage pour protéger les utilisateurs des effets néfastes de l'IA, a déclaré Imran Ahmed, PDG et fondateur du centre.

À lire également

«Si une image vaut mille mots, alors ces générateurs d'images dangereusement sensibles, associés aux efforts lamentables de modération de contenu des principaux médias sociaux, représentent un outil aussi puissant que jamais pour les mauvais acteurs afin de tromper les électeurs», a dit M. Ahmed. «Il s'agit d'un signal d'alarme pour les entreprises d'IA, les plateformes de médias sociaux et les législateurs : agissez maintenant ou mettez la démocratie américaine en danger.»

Les images ont suscité l'inquiétude de la droite et de la gauche, qui craignent qu'elles n'induisent les gens en erreur sur le soutien dont bénéficie l'ancien président parmi les Afro-Américains. Certains membres de l'entourage de M. Trump ont exprimé leur frustration face à la diffusion de ces fausses images, estimant que les scènes fabriquées sapent les efforts déployés par les républicains pour atteindre les électeurs noirs.

«Si vous voyez une photo de Trump avec des Noirs et que vous ne la voyez pas sur une page officielle de la campagne ou sur une page de substitution, c'est qu'elle n'a pas eu lieu», a affirmé Diante Johnson, président de la Black Conservative Federation (Fédération des conservateurs noirs). «Il est absurde de penser que la campagne de Trump devrait utiliser l'intelligence artificielle pour montrer son soutien aux Noirs.»

Les experts s'attendent à d'autres efforts pour utiliser des «deepfakes» générés par l'IA afin de cibler des blocs d'électeurs spécifiques dans les États clés de l'alternance, tels que les Latinos, les femmes, les Américains d'origine asiatique et les conservateurs plus âgés, ou tout autre groupe démographique qu'une campagne espère attirer, induire en erreur ou effrayer. Avec des dizaines de pays qui organisent des élections cette année, les défis posés par les «deepfakes» sont un problème mondial.

En janvier, des électeurs du New Hampshire ont reçu un appel téléphonique imitant la voix de M. Biden et leur disant, à tort, que s'ils votaient aux primaires de cet État, ils ne pourraient pas participer à l'élection générale. Un consultant politique a par la suite reconnu avoir créé cet appel robotisé, qui pourrait être la première tentative connue d'utilisation de l'IA pour interférer avec une élection américaine.

Ce type de contenu peut avoir un effet corrosif même s'il n'est pas cru, selon une étude réalisée en février par des chercheurs de l'université de Stanford sur l'impact potentiel de l'IA sur les communautés noires. Lorsque les gens se rendent compte qu'ils ne peuvent pas faire confiance aux images qu'ils voient en ligne, ils peuvent commencer à ignorer les sources d'information légitimes.

«À mesure que le contenu généré par l'IA devient plus répandu et difficile à distinguer du contenu généré par l'homme, les individus peuvent devenir plus sceptiques et se méfier des informations qu'ils reçoivent», écrivent les chercheurs.

Même s'ils ne parviennent pas à tromper un grand nombre d'électeurs, les contenus générés par l'IA sur le vote, les candidats et les élections peuvent rendre plus difficile la distinction entre la réalité et la fiction, ce qui conduit à écarter les sources d'information légitimes et à alimenter une perte de confiance qui sape la foi dans la démocratie tout en accentuant la polarisation politique.

Si les fausses affirmations sur les candidats et les élections n'ont rien de nouveau, l'IA permet de fabriquer plus rapidement, plus économiquement et plus facilement que jamais des images, des vidéos et des sons réalistes. Lorsqu'ils sont diffusés sur des plateformes de médias sociaux telles que TikTok, Facebook ou X, les «deepfakes» de l'IA peuvent atteindre des millions de personnes avant même que les entreprises technologiques, les responsables gouvernementaux ou les organes de presse légitimes ne soient au courant de leur existence.

«L'IA a tout simplement accéléré et accéléré la désinformation», a déclaré Joe Paul, chef d'entreprise et défenseur des droits de l'homme qui s'est efforcé d'améliorer l'accès au numérique des communautés de couleur. M. Paul a fait remarquer que les communautés noires ont souvent «une histoire de méfiance» à l'égard des grandes institutions, notamment dans le domaine de la politique et des médias, ce qui les rend plus sceptiques à l'égard des récits publics les concernant et de la vérification des faits destinée à informer la communauté.

Selon M. Paul, la culture numérique et l'esprit critique sont des moyens de défense contre la désinformation générée par l'IA. «L'objectif est de donner aux gens les moyens d'évaluer de manière critique les informations qu'ils trouvent en ligne. La capacité à penser de manière critique est un art perdu dans toutes les communautés, et pas seulement dans les communautés noires.»